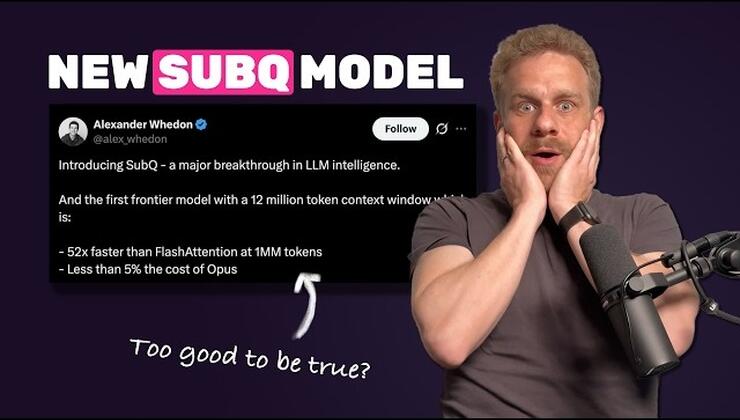

Пока OpenAI и Anthropic соревнуются в наращивании вычислительных мощностей, на горизонте появился амбициозный игрок — компания SubQ (Subquadratic). Их заявление звучит как вызов всей индустрии: они обещают интеллект уровня топовых моделей (GPT-5.5, Claude 4.7 Opus) при радикальном снижении затрат и невероятном контекстном окне.

Главные обещания SubQ:

- Контекст 12 миллионов токенов: Это позволяет загружать в модель целые кодовые базы, библиотеки юридических документов или сотни книг одновременно.

- Стоимость — 5% от аналогов: Инференс стоит в 20 раз дешевле, чем у текущих флагманов.

- Скорость: Модель работает значительно быстрее благодаря уходу от «квадратичной сложности».

Технология: Плотное vs. Разреженное внимание

Чтобы понять, в чем заключается магия SubQ, нужно вспомнить, как работают текущие лидеры рынка.

1. Плотное внимание (Dense Attention)

Используется в GPT и Claude. Для генерации каждого нового слова модель анализирует все предыдущие слова и связи между ними.

- Проблема: Сложность растет квадратично ($N^2$). Если вы удваиваете длину текста, вычислительная нагрузка растет в четыре раза. Это делает огромные контекстные окна (вроде 12 млн токенов) практически невозможными для обработки в реальном времени.

2. Разреженное внимание (Sparse Attention)

Подход SubQ строится на SSA (Sub-quadratic Selective Approach). Вместо того чтобы смотреть на всё сразу, модель выбирает только те части текста, которые «несут сигнал» для конкретного запроса.

Раньше у разреженного внимания были проблемы:

- Локальные окна: Модель видела только ближайшие слова, теряя суть документа.

- Глобальные токены (сжатие): Попытка сделать краткое резюме, в котором теряются важные детали.

Решение SubQ: Они используют «маршрутизацию, зависящую от контента». Модель сама определяет, какие части 12-миллионного контекста важны прямо сейчас, и обращается именно к ним, игнорируя «шум».

Результаты бенчмарков

SubQ представили данные по нескольким тестам, где их модель сравнивается с лидерами:

- RULER: Тест на извлечение информации и сложные рассуждения в длинном контексте. Модель показала уровень, сопоставимый с Claude 4.6 Opus.

- Разработка ПО (Coding): В задачах по написанию кода модель также идет вровень с флагманами, что доказывает: это не просто «поисковик по тексту», а полноценный интеллект.

Важное уточнение: Хотя цифры впечатляют, скептики напоминают, что бенчмарки часто «подкручивают» или оптимизируют модели специально под них. Реальную силу SubQ мы увидим только в «диких» условиях.

Почему это изменит всё?

Если технология SubQ подтвердится, это убьет сразу несколько «костылей», которыми мы пользуемся сегодня:

- Прощай, RAG: Больше не нужно нарезать документы на куски и использовать векторные базы данных. Можно просто «скормить» модели всё сразу.

- Замена субагентам: Вместо того чтобы передавать задачи между маленькими ИИ, одна модель сможет держать в памяти весь проект.

- Решение проблемы дефицита чипов: Более эффективные модели требуют меньше GPU и электричества, что критически важно в условиях мирового дефицита мощностей.

Хайп или реальность?

Пока стоит сохранять осторожность. У проекта:

- Нет открытой документации (Model Card).

- Мало технических подробностей о работе селективного механизма.

- Доступ открыт только по заявкам (Waitlist).

Вердикт: Если SubQ выполнят обещания, они станут компанией на триллион долларов, а правила игры в ИИ изменятся навсегда. Но пока мы ждем возможности протестировать модель лично, остается только гадать: действительно ли это «смерть» для OpenAI, или просто очередной громкий заголовок.

На основе Bye, Bye OpenAI & Anthropic?